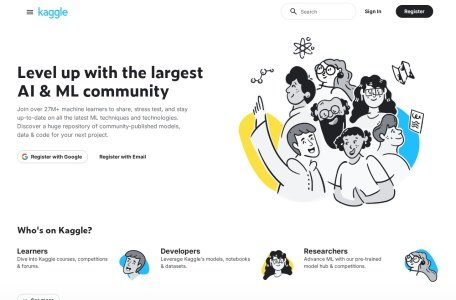

“想练 AI 却没有真实数据?做项目缺参考代码?竞赛获奖能当求职敲门砖吗?” 如果你有这些困惑,Kaggle 或许是答案。这个被誉为 “数据科学奥林匹克” 的平台,2025 年已汇聚全球 2500 万 + 机器学习从业者,沉淀了 50.8 万高质量数据集、140 万可复现 notebooks 和 2.52 万开源模型。从学生的入门练手到谷歌、奔驰等企业的难题求解,它早已成为 AI 领域的 “实战训练场”。本文结合 2025 年最新功能与竞赛趋势,带你吃透这个平台的核心价值。

一、平台本质:不止是竞赛,更是 AI 生态枢纽

Kaggle 的核心魅力在于 “连接数据、代码与人才”,其生态覆盖三大核心场景:

- 学习场景:70 + 小时免费课程从 Python 基础讲到大模型微调,配合 “泰坦尼克号生存预测” 等入门赛,新手可快速上手;

- 实战场景:企业与科研机构发布真实问题(如亚马逊雨林监测、宫颈癌筛查),参赛者提交模型比拼效果,优胜者拿奖金或工作 offer;

- 资源场景:从 1 分钟级比特币交易数据到 4GB 水果图像数据集,覆盖金融、CV、NLP 等 12 个领域,且支持免费调用 GPU/TPU 算力。

2025 年数据显示,83% 的 Top 50 科技公司会关注 Kaggle 竞赛获奖者,金牌选手的简历通过率比普通求职者高 3 倍。

二、核心资源库:2025 必用的 3 大宝藏板块

1. 数据集:50 万 + 数据,覆盖从入门到前沿

平台按 “可用性评分” 筛选数据,以下 4 类 2025 年热门数据集值得收藏:

| 数据集名称 | 规模 | 可用性评分 | 适用场景 |

|---|---|---|---|

| 比特币 1 分钟级交易数据 | 100MB | 10.0 | 时间序列预测、量化分析 |

| Fruits-360 果蔬图像集 | 4GB | 8.8 | 图像分类、迁移学习 |

| 1872-2025 国际足球赛事结果 | 1MB | 10.0 | 赛事预测、特征工程实践 |

| Formula 1 锦标赛数据 (1950-2024) | 7MB | 10.0 | 回归分析、数据可视化 |

这些数据均支持直接在 Kaggle Notebooks 中加载,无需本地存储。

2. Notebooks:140 万份代码,手把手学建模

Kaggle 的云端 Notebook 环境支持 TensorFlow、PyTorch 等主流框架,且提供免费 GPU(L4×4 配置)。2025 年最火的 3 类 Notebook:

- 大模型实践:如 Gemma 2 模型的 Keras 3 实现,兼容 Jax/TensorFlow/PyTorch 三大框架;

- 竞赛复盘:3000 + 篇金牌选手写的 “解题思路”,比如 SVG 图像生成竞赛的提示词工程技巧;

- 工具教程:Optuna 超参数调优、SigLIP 相似度计算等实用工具的实操案例。

新手可直接 fork(复制)高星 Notebook,修改参数即可快速复现结果。

3. 模型库:2.5 万 + 模型,即拿即用

2025 年 Kaggle Hub 新增 “一键部署” 功能,热门模型包括:

- 推理类:DeepSeek-R1 零样本推理模型,在数学题求解中准确率达 89%;

- 视觉类:ConvNeXt 轻量化模型,比 ResNet50 参数少 30% 但精度更高;

- 多语言类:XLM-RoBERTa,支持 100 + 语言的文本分类任务。

三、2025 新功能:Kaggle Packages 重构竞赛提交逻辑

今年最重磅的更新是 “Kaggle Packages” 功能,彻底改变了竞赛提交方式:

核心优势:从 “脚本提交” 到 “模型封装”

过去参赛者需提交完整代码,现在只需封装含predict()函数的Model类,平台自动处理测试集迭代与环境配置。以 “文本生成 SVG” 竞赛为例:

- 用

kagglehub加载预训练模型(如 Gemma 2); - 定义

Model类实现文本到 SVG 代码的转换; - 提交后平台用 SigLIP 模型计算生成图像与描述的相似度评分。

这一功能使代码复用率提升 60%,新手也能基于开源 Package 快速迭代。

使用技巧:避开 3 个常见坑

- SVG 文件需控制在 10KB 内,避免使用 CSS 样式元素;

- 提交前用官方

kaggle_evaluation工具包本地测试; - 禁用外部数据调用,否则评分阶段会报错。

四、竞赛实战:2025 冲奖攻略(分新手 / 高手)

1. 新手入门:从 “playground 赛” 到 “Featured 赛”

- 首选赛道:Tabular 数据竞赛(如房价预测),依赖特征工程而非高算力,XGBoost/LightGBM 即可出成绩;

- 必看资源:Titanic 竞赛的 100 + 篇公开 Notebook,掌握缺失值处理、目标编码等基础技巧;

- 时间规划:每周投入 5 小时,3 个月可冲击 Top 50%。

2. 高手冲金:瞄准百万级大奖

2025 年最值得参与的两大竞赛:

▶ ARC Prize 2025(奖金 100 万美元)

- 任务:构建 AI 模型实现 85%+ 的抽象推理准确率;

- 新规:需开源解决方案才能获取最终评分,算力提升至去年 2 倍(L4×4s);

- 关键:结合强化学习与视觉推理模型,避免过拟合。

▶ Google Gemma 3N 影响挑战

- 侧重:用 Gemma 模型解决社会问题(如医疗诊断辅助);

- 优势:提供专属 GPU 资源,获奖方案可纳入 Google 开发者生态。

3. 通用高分技巧

| 任务类型 | 最优模型组合 | 特征工程重点 |

|---|---|---|

| 表格数据 | XGBoost+CatBoost 集成 | 类别变量目标编码、时间特征拆分 |

| 计算机视觉 | ResNet50(小数据)/ViT(大数据) | 图像增强、注意力机制微调 |

| NLP | BERT(短文本)/LLaMA 2(长文本) | 词嵌入可视化、噪声数据清洗 |

五、适用人群:3 类人用 Kaggle 效果翻倍

1. 学生:低成本积累实战经验

- 入门路径:Coursera 机器学习课程 → Kaggle 入门赛 → 发表 Notebook;

- 加分项:参与 Recruitment 类竞赛,直接获得 Facebook、Airbnb 等企业面试机会。

2. 在职者:转行 / 晋升的 “敲门砖”

- 数据分析师:练 “国际足球赛事预测”,掌握 Pandas 可视化与回归分析;

- AI 工程师:主攻 “SVG 生成竞赛”,熟悉大模型微调与工程化封装。

3. 研究者:快速验证创新思路

用 Kaggle 的公开数据集测试新算法,比如在 “肺癌预测” 数据集上验证改进的 U-Net 模型性能,且支持一键引用数据集发表论文。

六、2025 避坑指南:老玩家总结的 5 条教训

- 别盲目追大模型:Tabular 数据竞赛中,XGBoost 常击败 Transformer,先跑基线模型再优化;

- 控制过拟合:ARC Prize 2025 新增半私有排行榜,避免刷公开集分数;

- 善用免费算力:GPU 每日限额 12 小时,优先在夜间跑大型模型训练;

- 关注社区动态:论坛 “Discussion” 板块常有隐藏的特征工程技巧;

- 及时备份代码:Notebook 自动保存但易误删,每周导出至 GitHub。

结语:Kaggle 的真正价值,是 “实战中成长”

2500 万用户的选择证明:Kaggle 不是单纯的竞赛平台,而是 AI 从业者的 “成长加速器”。它不需要你有深厚的理论基础 —— 从免费数据集练手,到参与百万级竞赛,每一步都能获得真实反馈。

如果你正卡在 “学了 AI 却不会用” 的阶段,不妨从 Titanic 入门赛开始,或直接 fork 一篇 Gemma 模型实战 Notebook。毕竟,在 Kaggle 上提交的第一行代码,可能就是你 AI 职业生涯的起点。

相关导航

Txyz

Bobby

Zread

Lovart

MGX(MetaGPT-X)

Dia Browser

MiniMax Agent